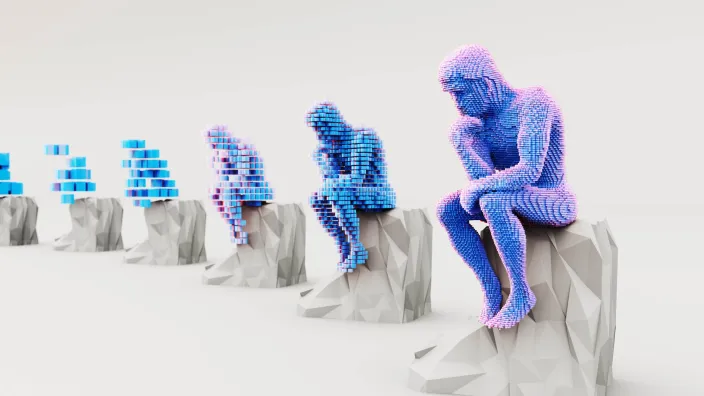

ChatGPT non è un oracolo

L’altro giorno ho sentito una persona con una posizione molto elevata nella propria carriera professionale dire:

«Non sapevo come rispondere a quella domanda perché non capivo cosa intendessero con quel termine in quel contesto, così ho chiesto a ChatGPT di chiarire il mio dubbio».

In una bella domenica, un mio amico mi racconta che vuole cambiare la dieta del suo cane perché sta invecchiando. Sta pensando di chiedere a ChatGPT di calcolare le proporzioni della dieta. Mi chiede cosa ne penso. Non faccio nemmeno in tempo a rispondere: vede la mia espressione preoccupata e continua dicendo: «Sì, poi posso chiedere a Claude o Deepseek di confrontare le risposte e stimare l’accuratezza». A quel punto, la mia espressione preoccupata diventa ancora più evidente, trasformandosi quasi in disperazione.

Questi sono solo alcuni esempi di ciò che ho sentito o vissuto nelle ultime settimane: un esperto che si affida a risposte generate come fonte di verità e un amico che confronta diversi sistemi di intelligenza artificiale come metodo per stimare l’accuratezza delle informazioni generate. Istintivamente, la mia reazione è: «assolutamente no — per favore smettete subito di farlo». Poi subentra la mia parte da ricercatrice e si chiede: dove sono gli articoli scientifici che dimostrano che questo comportamento è molto problematico? Ce ne sono moltissimi.

Errori e compiacenza

Esiste un’ampia letteratura che mostra i comportamenti problematici dei large language models (LLM), gli stessi modelli linguistici che alimentano interfacce conversazionali come ChatGPT, Claude e Deepseek. Ad esempio, le citazioni di articoli generate dagli LLM sono spesso allucinate o collocate in modo errato; i riassunti prodotti tramite ricerche web con retrieval-augmented generation (RAG) possono non riflettere accuratamente il contenuto delle pagine web originali; le informazioni fattuali possono essere inventate; le conoscenze a bassa frequenza nei dati di addestramento sono difficili da apprendere per gli LLM; e gli LLM mostrano comportamenti di compiacenza, concordando con gli utenti anche quando la risposta è errata. Questo elenco di limiti non è esaustivo ed è in continua crescita.

Solo una porzione molto ridotta dei dati di addestramento è considerata “di alta qualità”

I cosiddetti LLM sono stati per lo più addestrati su documenti (pagine web) raccolti da internet. Le informazioni che apprendono sono quelle presenti in queste pagine. La stragrande maggioranza di esse proviene in realtà da blog e forum che non sono mai stati verificati in termini di accuratezza o veridicità. Solo una porzione molto ridotta dei dati di addestramento è considerata “di alta qualità”, perché proviene, ad esempio, da testate giornalistiche accreditate, pagine Wikipedia, libri e articoli sottoposti a revisione paritaria. Inoltre, anche se gli LLM sono addestrati da organizzazioni diverse, poiché questi modelli sono estremamente avidi di dati, i loro creatori utilizzano quanta più informazione possibile disponibile su internet (filtrata per contenuti dannosi). Di conseguenza, gli LLM creati da organizzazioni diverse finiscono per avere bias simili e rispondere alle richieste degli utenti in modo simile, come dimostrato da studi precedenti.

Tornando all’esempio del mio amico e del cane, questa è già una prova sufficiente del fatto che, se un modello sbaglia, è molto probabile che anche l’altro sbagli — a meno che non sia stato successivamente allineato con informazioni corrette, cosa che non abbiamo modo di sapere, dato che la maggior parte delle interfacce conversazionali basate su LLM disponibili online, come ChatGPT e Claude, sono proprietarie e quindi il loro addestramento ci è sconosciuto.

I limiti del Chatbot

Il mio punto non è smettere di usare ChatGPT e altre interfacce conversazionali, perché si tratta di tecnologie linguistiche destinate a rimanere e ad aiutarci a essere più creativi, produttivi ed efficienti. Tuttavia, esistono due differenze principali tra le fonti più tradizionali e i chatbot basati su LLM.

La prima è che questi strumenti elaborano e riassumono le informazioni per noi in misura molto maggiore rispetto ai libri, aumentando il loro fascino grazie alla comodità e all’efficienza. In fondo, noi esseri umani amiamo scorciatoie che riducano il carico cognitivo. La seconda è che ogni interazione con un LLM è nuova e la stessa domanda può ricevere risposte diverse anche se posta con lo stesso prompt (provate voi stessi). Ciò significa che le risposte fornite da queste tecnologie non sono state sottoposte a revisione tra pari, né verificate, né a un processo editoriale o decisionale.

Brainstorming a rischio

Detto questo, il mio punto principale è che dobbiamo essere ancora più critici nei confronti di questi strumenti rispetto a quando consumiamo informazioni provenienti dai media tradizionali. In pratica, questo significa verificare i contenuti generati confrontandoli con fonti autorevoli, invece di accettarli così come sono. Questo può essere fatto in modo diverso a seconda del compito. Attività come parafrasare o tradurre testi sono generalmente a basso rischio, perché lo strumento si limita a trasformare informazioni che abbiamo già scritto, anche se l’output dovrebbe comunque essere rivisto per evitare possibili fraintendimenti.

Chiedere agli LLM di fare brainstorming, spiegare concetti o recuperare fatti è considerato più rischioso

Al contrario, chiedere agli LLM di fare brainstorming, spiegare concetti o recuperare fatti è considerato più rischioso, perché le informazioni risultanti possono contenere errori o disinformazione a causa delle allucinazioni o semplicemente perché l’LLM ha appreso informazioni scorrette. La veridicità delle risposte generate in questi compiti ad alto rischio dovrebbe essere valutata con attenzione e confermata attraverso altre fonti autorevoli. Sono consapevole che questo processo richieda più tempo… ma raggiungere una realtà in cui la verità è secondaria è davvero un buon compromesso in cambio di una maggiore “efficienza”?